Искусственный интеллект и машинное обучение обеспечивают многие из достижений, которые мы наблюдаем сегодня в технологической отрасли. Но как машинам дается способность учиться? Кроме того, как способ, которым мы делаем это, приводит к непредвиденным последствиям?

Вот наш краткий объяснение того, как работают алгоритмы машинного обучения, а также некоторые примеры машинного обучения.

Что такое алгоритмы машинного обучения?

Машинное обучение — это отрасль информатики, которая фокусируется на предоставлении ИИ способности изучать задачи.

, Это включает в себя развитие способностей без программистов, явно кодирующих AI для выполнения этих задач. Вместо этого ИИ может использовать данные для обучения.

Программисты достигают этого с помощью алгоритмов машинного обучения. Эти алгоритмы являются моделями, на которых основано поведение обучения ИИ. Алгоритмы в сочетании с обучающими наборами данных позволяют ИИ учиться.

Алгоритм обычно предоставляет модель, которую ИИ может использовать для решения проблемы. Например, научиться распознавать картинки кошек и собак. AI применяет модель, изложенную алгоритмом, к набору данных, который включает изображения кошек и собак. Со временем ИИ научится распознавать кошек у собак более точно и легко, без участия человека.

Машинное обучение улучшает такие технологии, как поисковые системы, устройства для умного дома, онлайн-сервисы и автономные машины. Именно так Netflix знает, какие фильмы вам больше всего нравятся, и как службы потоковой передачи музыки могут порекомендовать плейлисты.

Но хотя машинное обучение может сделать нашу жизнь намного проще, возможны и неожиданные последствия.

7 раз, когда машинное обучение пошло не так

1. Неудачи в результатах поиска картинок Google

Поиск Google значительно упростил навигацию в Интернете. Алгоритм движка принимает во внимание множество вещей, таких как ключевые слова и показатель отказов. Но алгоритм также учитывает пользовательский трафик, что может вызвать проблемы с качеством результатов поиска.

Нигде это не так очевидно, как в результатах изображения. Поскольку страницы, которые получают большой трафик, с большей вероятностью будут отображать свои изображения, истории, которые привлекают большое количество пользователей, включая клик-приманку, часто имеют приоритет.

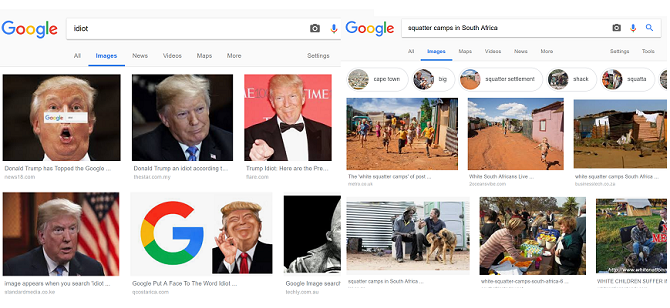

Например, результаты поиска изображений для «лагерей сквоттеров в Южной Африке» вызвали споры, когда было обнаружено, что в них преобладают белые южноафриканцы. И это несмотря на статистические данные, показывающие, что подавляющее большинство людей, живущих в неформальном жилье, таких как лачуги, являются чернокожими южноафриканцами.

Факторы, используемые в алгоритме Google, также означают, что пользователи Интернета могут манипулировать результатами. Например, кампания пользователей повлияла на результаты поиска картинок Google в той степени, в которой при поиске термина «идиот» показываются изображения президента США Дональда Трампа.

2. Microsoft Bot превратился в нациста

Доверьтесь Твиттеру, чтобы испортить добродушного чат-бота с машинным обучением. Это то, что произошло в течение дня после выпуска печально известного чат-бота Microsoft Тея.

Тай подражал языковым моделям девочки-подростка и изучал ее взаимодействия с другими пользователями Твиттера. Тем не менее, она стала одним из самых печально известных ошибок ИИ, когда она начала делиться нацистскими заявлениями и расовыми оскорблениями. Оказывается, что тролли использовали машинное обучение ИИ против него, наводняя его взаимодействиями, нагруженными фанатизмом.

Вскоре Microsoft навсегда отключила Tay.

3. Проблемы распознавания лиц AI

Распознавание лиц ИИ часто попадает в заголовки по всем неправильным причинам, таким как истории о распознавании лиц и проблемах конфиденциальности. Но этот ИИ также вызывал огромные опасения при попытке узнать цветных людей.

В 2015 году пользователи обнаружили, что Google Фото классифицирует некоторых чернокожих как горилл. В 2018 году исследование ACLU показало, что программное обеспечение Amazon для распознавания лиц Rekognition идентифицировало 28 членов Конгресса США как подозреваемых полицией, причем ложные срабатывания непропорционально влияли на цветных людей.

Еще один инцидент связан с программным обеспечением Apple Face ID

неправильно идентифицируя двух разных китайских женщин как одного и того же человека. В результате коллега владельца iPhone X может разблокировать телефон.

Между тем, исследователь MIT Джой Буоламвини вспоминает, что ей часто приходилось надевать белую маску во время работы над технологией распознавания лиц, чтобы программное обеспечение распознало ее. Чтобы решить подобные проблемы, Buolamwini и другие ИТ-специалисты обращают внимание на проблему и необходимость более инклюзивных наборов данных для обучения искусственному интеллекту.

4. Deepfakes, используемые для мистификации

Хотя люди уже давно используют Photoshop для создания ложных изображений, машинное обучение выводит это на новый уровень. Программное обеспечение, такое как FaceApp, позволяет вам обмениваться объектами из одного видео в другое.

Но многие люди используют программное обеспечение для различных злонамеренных применений, в том числе для наложения знаменитостей на видео для взрослых или для создания фальшивых видео. Между тем, пользователи интернета помогли усовершенствовать технологию, чтобы было все труднее отличить реальные видео от поддельных. В результате это делает этот тип ИИ очень мощным с точки зрения распространения фальшивых новостей и мистификаций.

,

Чтобы продемонстрировать всю мощь этой технологии, директор Джордан Пил и генеральный директор BuzzFeed Джона Перетти создали фальшивое видео, демонстрирующее, как кажется, бывший президент США Барак Обама, поставляющий СРП о мощи глубоких подделок.

5. Восстание Twitter-ботов

Боты Twitter были изначально созданы для автоматизации таких вещей, как ответы клиентов за обслуживание брендов. Но технология в настоящее время является основной причиной для беспокойства. На самом деле, исследования показали, что до 48 миллионов пользователей в Твиттере на самом деле являются ИИ-ботами.

Вместо того, чтобы просто использовать алгоритмы, чтобы следовать определенным хэштегам или отвечать на запросы клиентов, многие аккаунты ботов пытаются подражать реальным людям. Затем эти «люди» пропагандируют обман и помогают распространять фальшивые новости.

Волна ботов в Твиттере даже повлияла на общественное мнение в определенной степени на Brexit и президентских выборах в США 2016 года. Сам Твиттер признал, что обнаружил около 50 000 ботов российского производства, которые опубликовали информацию о выборах.

Боты продолжают мучить службу, распространяя дезинформацию. Проблема настолько распространена, что даже влияет на оценку компании.

6. Сотрудники говорят, что Amazon AI решил, что найм мужчин лучше

В октябре 2018 года агентство Reuters сообщило, что Amazon пришлось отказаться от инструмента для поиска работы после того, как ИИ программного обеспечения решил, что кандидаты-мужчины предпочтительнее.

Сотрудники, пожелавшие остаться неизвестными, выступили, чтобы рассказать Reuters о своей работе над проектом. Разработчики хотели, чтобы ИИ определял лучших кандидатов на работу на основе их резюме. Однако люди, участвующие в проекте, вскоре заметили, что ИИ наказала женщин-кандидатов. Они объяснили, что в качестве тренировочного набора данных ИИ использовал резюме прошлого десятилетия, большинство из которых были от мужчин.

В результате ИИ начал фильтровать резюме по ключевому слову «женщины». Их ключевое слово появилось в резюме в рубрике «Капитан женского шахматного клуба». В то время как разработчики изменили ИИ, чтобы предотвратить наказание женских резюме, в конечном итоге Amazon отказался от проекта.

7. Несоответствующий контент на YouTube Kids

На YouTube Kids есть много глупых, причудливых видеороликов, предназначенных для развлечения детей. Но у этого также есть проблема спам-видео, которые манипулируют алгоритмом платформы.

Эти видео основаны на популярных тегах. Поскольку маленькие дети не очень проницательные зрители, нежелательные видео, использующие эти ключевые слова, привлекают миллионы просмотров. AI автоматически генерирует некоторые из этих видеороликов с использованием стандартных элементов анимации на основе трендовых тегов. Даже когда ролики сняты аниматорами, их заголовки специально создаются для вставки ключевых слов.

Эти ключевые слова помогают манипулировать алгоритмом YouTube, чтобы в итоге они оказались в рекомендациях. Значительное количество неприемлемого контента появилось в каналах детей, использующих приложение YouTube Kids. Это включает в себя контент, который изображает насилие, прыжки и сексуальный контент.

Почему машинное обучение идет не так

Есть две основные причины, по которым машинное обучение приводит к непредвиденным последствиям: данные и люди. С точки зрения данных, мантра «мусор, мусор» применяется. Если данные, которые подаются на AI, ограничены, смещены или имеют низкое качество; Результатом является ИИ с ограниченными возможностями или смещением.

Но даже если программисты получают правильные данные, люди могут взломать дело. Создатели программного обеспечения часто не понимают, как люди могут использовать технологию злонамеренно или в корыстных целях. Deepfakes пришли из технологии, используемой для улучшения спецэффектов в кино.

То, что направлено на создание более захватывающих развлечений, также приводит к разрушению жизни людей при эксплуатации.

Есть люди, работающие над улучшением мер безопасности для технологии машинного обучения для предотвращения злонамеренного использования. Но технология уже здесь. Между тем, многие компании не проявляют необходимой силы воли, чтобы предотвратить злоупотребление этими событиями.

Алгоритмы машинного обучения могут помочь нам

Когда вы понимаете, насколько машинное обучение и искусственный интеллект не соответствуют ожиданиям, это может показаться мрачным и мрачным. Но это также помогает нам во многих отношениях — не только с точки зрения удобства, но и улучшения нашей жизни в целом.

Если вы немного сомневаетесь в положительном влиянии ИИ и машинного обучения, узнайте, как искусственный интеллект борется с киберпреступностью

и хакеры, чтобы восстановить надежду.